Раскрутка сайта, поисковики и... mod_rewrite

Всем привет! Для кого предназначена эта статья - для веб разработчиков, для которых реально, что вся раскрутка сайта, которая ему (сайту) нужна, заключается в достижение высших позиций в наиболее популярных поисковых машинах по интересующим ключевым словам, ну и для остальных работников рекламы в интернете (для общего развития, так сказать :-)

ОК. Сразу к делу - как известно, не все еще люди научились пользоваться правильными поисковыми машинами типа Google или Yandex, многие (видать, по-старинке) продолжают использовать для поиска в Интернете поисковики НЕправильные. В чем различие между правильным и НЕправильным поисковиком? Навскидку, оных различий много, но одно из основных - это то, что НЕправильные поисковые машины НЕ индексируют сайты c динамическим содержимым . Мы здесь не будем показывать пальцем, но таких поисковиков достаточно много (например тот, который на "Ра" начинается и на "мблер" заканчивается).

И вот допустим, что вы решили создать и раскрутить сайт (реклама в интернете - великая вещь ;-) Да вот незадача - вы хотите иметь на оном сайте и гостевую книгу, и каталог товаров, и... И для этого сайт должен быть динамическим. И адреса у вас в оном каталоге будут типа ...?tovar=good&indexed=false - так что вышеупомянутый "мблер" оставит ваш сайт за бортом :-( Конечно, вы можете сказать - "Да мы раскрутим сайт и безо всякого там Рамблера! Да нам на Ра..." - расскажу вам историю двухнедельной давности:

Прихожу я в одну контору (мы вели переговоры отн. создания трех сайтов). Ну сидим мы общаемся. Вопрос заказчика:

- А вы сможете вывести нас в первую десятку сайтов, выдаваемых Рамблером по ключевому слову "......"

- Ну да, конечно, хотя я предпочитаю использовать Гугль, когда ищу по вашей тематике.

- ??? А что такое Гугль???

Вот так-то! А вы говорите Яндекс :)

Можно, конечно (ежели уж совсем серьезно подойти к рекламе в интернете - а как иначе? :) делать отдельный сайт для каждого отдельного поисковика (и в общем-то это правильно), но тогда вам понадобится создать и раскрутить не один, как минимум 3-5 сайтов, что весьма и весьма трудоемко.

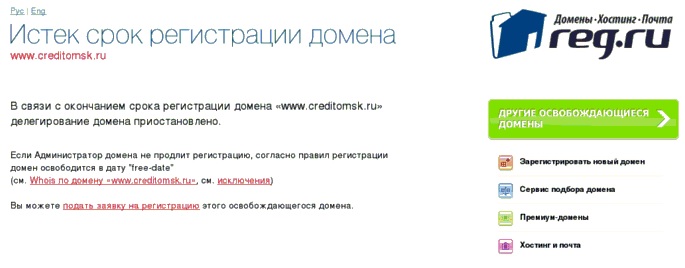

В общем, я расскажу вам об основах того, как сделать, чтобы ваш динамический сайт индексировался Рамблером и другими подобными скриптоненавистническими поисковыми системами. Данная технология используется на моем новом сайте/

Во первых давайте посмотрим вот на что: каким именно образом робот понимает, что ваш сайт имеет динамическую структуру? Правильно - он смотрит параметр 'href' тэга 'A' и если в оном есть знаки ? или & и если робот НЕправильный, то страницу по данному адресу он индексировать не будет. Таким образом, задача заключается в том, чтобы убрать из строки урла вышеупомянутые символы. А как же тогда передавать параметры скрипту? Как...

Далее по пунктам (ежели что непонятно будет пишите лично - разберемся). Все повествование будет вестись на основе реальной разработки, и на выходе мы получим маленький жизнеспособный скрипт, поняв принципы работы которого, вы сможете написать большой и глючный интернет-магазин ;-)

- Давайте сразу четко сформулируем задачу: нам нужно каким-то образом вызвать некий скрипт и передать ему некие параметры, при этом адресная строка должна выглядеть как для нормального, статического сайта. Это просто, если мы передаем скрипту данные из формы - ставим "POST" и все дела. Но мы то с вами должны передать параметры из гиперссылки, то есть через URL, то есть методом GET, то есть в УРЛе будут ? или &, то есть...

ОК. Есть такой файл, называется .htaccess - в нем вы можете задать некотрые директивы, управляющие сервером Apache (сложно писать для "широкой" аудитории - кто-то сейчас читает и думает про себя - чего он тут нам "азбуку жует", а кто-то прочитал предыдущую фразу, и материт меня за "тарабарщину всякую"). Ну и ладно. В общем знать об этом самом .htaccess нужно примерно следующее - разместив оный файл в какой-либо папке на сервере, и написав в нем всякие штуки, мы можем изменить поведение сервера, применительно к данной папке (если, конечно хост провайдер разрешает). Короче:

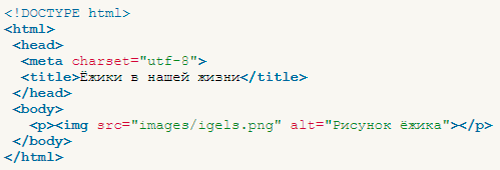

Помещаем файл с именем .htaccess в корневую папку свего сайта (DocumentRoot) - обычно она называется WWW или www

И пишем в него следующие строки:

RewriteEngine on

RewriteRule ^core.php$ - [L]

RewriteRule .* /core.php

О чем это я? Аааа... ну да - есть такой модуль Apache - mod_rewrite называется. Описание данного модуля, как это обычно говорится, выходит за рамки данной статьи - суть в том, что mod_rewrite делает с путями на сервере, что душе угодно и использует синтаксис регулярных выражений в стиле Perl - интересующиеся могут порыться в интернете в поисках документации к оному. И все же, что мы там понаписали в .htaccess

RewriteEngine on

# Данной директивой .htaccess мы включаем mod_rewrite

RewriteRule ^core.php$ - [L]

# Даем понять серверу, что если запрошен файл с именем core.php (название может быть произвольным) то с оным файлом нужно поступить так, как обычно сервер поступает с предателями... простите с файлами, имеющими расширение .php - передать на обработку дальше (модулю PHP).

RewriteRule .* /core.php

# Внимание! Здесь происходит то, ради чего мы и городим весь огород - теперь, что бы мы не написали в адресной строке - не имеет (пока не имеет) ни какого значения - в любом случае будет вызван скрипт с именем core.php Но! Но в адресной строке набранный адрес остается прежним, то есть переменная окружения REQUEST_URI если набрано, например www.somehost.org/123 будет равна именно этому самому 123 и... - И мы можем запросто разобрать эту строку в core.php, таким образом, мы передаем данные прямо в имени файла!!!

Пишем тестовый скрипт и сохраняем как core.php :

function parse($uri){

if($uri){

// вырезаем цифровые значения из строковой переменной $uri в массив $uri_number

eregi("[[:digit:]]+",$uri,$uri_number);

//выводим первый элемент массива в браузер

echo $uri_number[0];

}

}

// вызываем функцию с глобальной переменной $REQUEST_URI в качестве параметра

parse($REQUEST_URI); - Теперь набираем в строке браузера что-нибудь типа http://имя_вашего_хоста/vasia12345.html Уррра!!! Получилось! (у меня все работает по крайней мере :-) Заметьте, что мы вызвали несуществующий файл vasia12345.html - сервер вернул нам OK (т.е. файл найден) - и вывел в браузер цифры 12345. Оные же цифры и буквы (для тех кто в танке ;-) можно передавать в качестве параметров в функции, внутри скрипта и пр.

Рамблер доволен, мы довольны, все довольны! :-))

В заключение, хочу отметить, что описанный метод, далеко не единственный - я знаю по меньшей мере еще три способа избавиться от прелестей метода GET. Но данный путь, на мой взгляд самый гибкий и удобный.

|

Всем привет! Для кого предназначена эта статья - для веб разработчиков, для которых реально, что вся раскрутка сайта, которая ему (сайту) нужна, заключается в достижение высших позиций в наиболее |

РэдЛайн, создание сайта, заказать сайт, разработка сайтов, реклама в Интернете, продвижение, маркетинговые исследования, дизайн студия, веб дизайн, раскрутка сайта, создать сайт компании, сделать сайт, создание сайтов, изготовление сайта, обслуживание сайтов, изготовление сайтов, заказать интернет сайт, создать сайт, изготовить сайт, разработка сайта, web студия, создание веб сайта, поддержка сайта, сайт на заказ, сопровождение сайта, дизайн сайта, сайт под ключ, заказ сайта, реклама сайта, хостинг, регистрация доменов, хабаровск, краснодар, москва, комсомольск |

|

Всем привет! Для кого предназначена эта статья - для веб разработчиков, для которых реально, что вся раскрутка сайта, которая ему (сайту) нужна, заключается в достижение высших позиций в наиболее |

РэдЛайн, создание сайта, заказать сайт, разработка сайтов, реклама в Интернете, продвижение, маркетинговые исследования, дизайн студия, веб дизайн, раскрутка сайта, создать сайт компании, сделать сайт, создание сайтов, изготовление сайта, обслуживание сайтов, изготовление сайтов, заказать интернет сайт, создать сайт, изготовить сайт, разработка сайта, web студия, создание веб сайта, поддержка сайта, сайт на заказ, сопровождение сайта, дизайн сайта, сайт под ключ, заказ сайта, реклама сайта, хостинг, регистрация доменов, хабаровск, краснодар, москва, комсомольск |

Дайджест новых статей по интернет-маркетингу на ваш email

Новые статьи и публикации

- 2024-04-17 » 23 сервиса для эффективного экспресс-аудита любого сайта

- 2024-04-08 » Яндекс переходит на новую версию Wordstat

- 2024-04-08 » Яндекс интегрировал в свой облачный сервис эмпатичную нейросеть

- 2024-04-08 » Новая версия нейросети Claude превзошла по мощности аналоги Google и OpenAI

- 2024-04-08 » Как пользоваться GPT 4 и Claude бесплатно и без VPN

- 2024-03-13 » Стратегии SEO на 2024 год

- 2024-03-13 » Как использовать анимацию с помощью JavaScript-библиотеки GSAP

- 2024-03-13 » Использование GSAP 3 для веб-анимации

- 2024-03-13 » Cогласование топографической съёмки с эксплуатирующими организациями

- 2024-02-19 » Теряются лиды? Как настроить сквозную аналитику

- 2024-02-17 » Мерч и IT: на что обратить внимание в 2024 году

- 2024-02-16 » Копируем с RSync: основные примеры синхронизации файлов

- 2024-02-15 » Лучшие noCode AI платформы для создания диалоговых ботов

- 2024-02-14 » Факторы ранжирования Google 2024 — исследование Semrush

- 2024-02-12 » Перенос сайта на другой хостинг

- 2024-02-05 » В России сформирован реестр хостинг-провайдеров

- 2024-02-04 » Использование SSH для подключения к удаленному серверу Ubuntu

- 2024-02-03 » Подключаемся к серверу за NAT при помощи туннеля SSH. Простая и понятная инструкция

- 2024-02-02 » Настройка CI/CD для Gitlab-репозитория: схемы и гайд по шагам

- 2024-02-01 » GitLab CI Pipeline. Запуск сценария через SSH на удаленном сервере

- 2024-01-29 » Introduction to GitLab’s CI/CD for Continuous Deployments

- 2024-01-26 » Настройка GitLab CI/CD

- 2024-01-25 » Установка shell gitlab runner

- 2024-01-25 » Установка и регистрация gitlab-runner в docker контейнере

- 2024-01-25 » Переменные Gitlab-Ci

- 2024-01-25 » Настройка CI/CD в GitLab для синхронизации проекта с веб-серверами

- 2024-01-25 » Копирование файлов scp

- 2024-01-21 » Бездепозитные бонусы от казино: обзор условий и правил использования

- 2024-01-18 » Современная обработка ошибок в PHP

- 2024-01-18 » Пример шаблона проектирования MVC в PHP

Там, где речь заходит об очень больших деньгах, разумно не доверять никому. |

Мы создаем сайты, которые работают! Профессионально обслуживаем и продвигаем их !

Как мы работаем

Заявка

Позвоните или оставьте заявку на сайте.

Консультация

Обсуждаем что именно Вам нужно и помогаем определить как это лучше сделать!

Договор

Заключаем договор на оказание услуг, в котором прописаны условия и обязанности обеих сторон.

Выполнение работ

Непосредственно оказание требующихся услуг и работ по вашему заданию.

Поддержка

Сдача выполненых работ, последующие корректировки и поддержка при необходимости.

Мы создаем практически любые сайты от продающих страниц до сложных, высоконагруженных и нестандартных веб приложений! Наши сайты это надежные маркетинговые инструменты для успеха Вашего бизнеса и увеличения вашей прибыли! Мы делаем красивые и максимально эффектные сайты по доступным ценам уже много лет!

Мы создаем практически любые сайты от продающих страниц до сложных, высоконагруженных и нестандартных веб приложений! Наши сайты это надежные маркетинговые инструменты для успеха Вашего бизнеса и увеличения вашей прибыли! Мы делаем красивые и максимально эффектные сайты по доступным ценам уже много лет! Комплексный подход это не просто продвижение сайта, это целый комплекс мероприятий, который определяется целями и задачами поставленными перед сайтом и организацией, которая за этим стоит. Время однобоких методов в продвижении сайтов уже прошло, конкуренция слишком высока, чтобы была возможность расслабиться и получать \ удерживать клиентов из Интернета, просто сделав сайт и не занимаясь им...

Комплексный подход это не просто продвижение сайта, это целый комплекс мероприятий, который определяется целями и задачами поставленными перед сайтом и организацией, которая за этим стоит. Время однобоких методов в продвижении сайтов уже прошло, конкуренция слишком высока, чтобы была возможность расслабиться и получать \ удерживать клиентов из Интернета, просто сделав сайт и не занимаясь им...

Мы оказываем полный комплекс услуг по сопровождению сайта: информационному и техническому обслуживанию и развитию Интернет сайтов.

Мы оказываем полный комплекс услуг по сопровождению сайта: информационному и техническому обслуживанию и развитию Интернет сайтов.

Контекстная реклама - это эффективный инструмент в интернет маркетинге, целью которого является увеличение продаж. Главный плюс контекстной рекламы заключается в том, что она работает избирательно.

Контекстная реклама - это эффективный инструмент в интернет маркетинге, целью которого является увеличение продаж. Главный плюс контекстной рекламы заключается в том, что она работает избирательно.