Фильтры поисковых систем: фильтры Яндекса и фильтры Google (Гугла)

Поисковые системы, в заботе о пользователях, стараются отсеять сайты, которые на их взгляд кажутся не подобающими и не заслуживающими место в поисковой выдаче. Чтобы осуществить этот самый отсев, поисковые системы используют специальные фильтры. Конечно, нам известны далеко не все существующие фильтры поисковых систем фильтры поисковых систем, ибо поисковики хранят их в секрете, но кое какие все-таки выплыли наружу.

Бан – этот фильтр Яндекса можно считать поистине самым страшным, так как при попадании под сей фильтр ресурс исключается из индекса поисковиков. Бан налагается с участием модератора при нарушении правила лицензии. При хорошем раскладе можно выйти из бана устранив его первопричину и написав об изменениях в службу поддержки Яндекса, обычно на рассмотрение писем такого рода уходит где-то тридцать дней. В худшем случае бан может оказаться пожизненным и тогда единственный выход – это смена владельца ресурса и начисто переписанный контент.

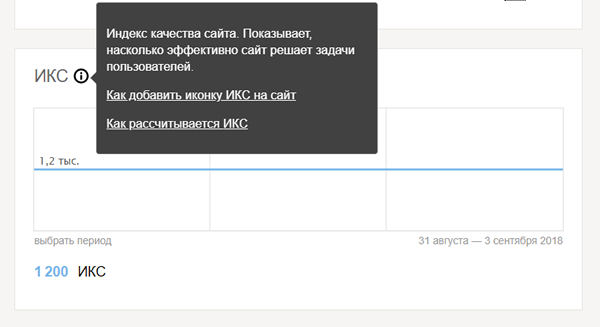

Обнуление ТИЦ происходит на автомате при попадании сайта под Яндекс фильтр бан. Вернуть обратно ТИЦ можно только вытащив ресурс из бана. В случае, если вы написали в службу поддержки и вам ответили, что сайт не под фильтром, тогда, возможно, это просто-напросто глючит движок поисковика и при следующем апдейте все вернется на круги своя.

Потеря позиций в поисковой выдаче – под этот фильтр попадают ресурсы, которые ставят слишком много исходящих ссылок на другие сайты. В случае попадания под фильтр ресурс нельзя будет найти по ключевым запросам. Этого можно избежать, снижая количество внешних ссылок.

Яндекс фильтр АГС (АГС-17 и АГС-30) – данный фильтр убирает из индекса ресурсы, например сателлиты, которые были созданы для поискового спама, отличительной чертой которых является наличие некачественного контента.

Непот – фильтр, применяющийся к ресурсам, которые подозреваются в продаже ссылок, ссылочном спаме и неестественности этих самых ссылок. Результатом этого фильтра будет неучет внешних ссылок с ресурса. К счастью, на позицию в поисковой выдаче этот фильтр не влияет.

Пессимизация – один из yandex filterфильтров Яндекс , накладывающийся на ресурсы, которые совершают обмен ссылками с нетематическими ресурсами. Результатом этого фильтра так же будет неучет внешних ссылок с сайта. Так что старайтесь обмениваться ссылками только с сайтами близкими по тематике.

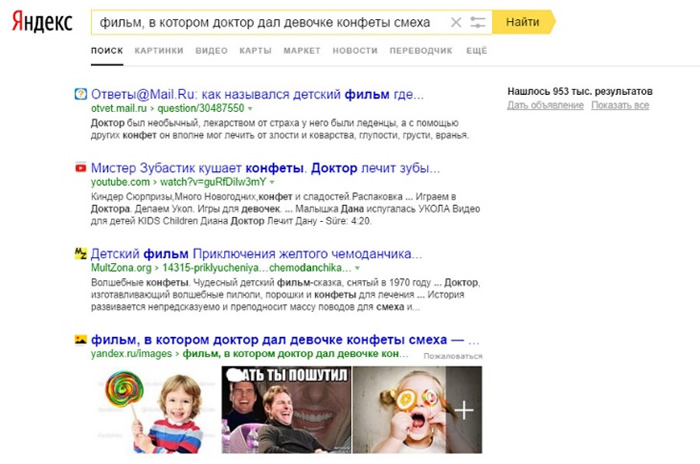

Ты последний – этот фильтр применяется к ресурсам, которые заподозрены в плагиате, то есть дублировании контента других интернет страниц. Результатом наложения данного фильтра будет долгое падение ресурса в поисковой выдаче. Сайт больше не будет появляться в выдаче по высокочастотным запросам. Выйти из под фильтра поможет замена уличенного контента на свой и уникальный.

Exceed Density Keywords filter применим к страницам плотность ключевиков которой зашкаливает. Оптимальной плотностью считается 4-6 %. Наказанием за такое нарушение является удаление страницы из индекса. Так что нужно держать себя в руках, расставляя ключевики.

Редирект фильтр применяется к ресурсам, которые пользуют Java Script редирект. Чаще всего это явление встречается на дорвеях, изначальная задача которых – перенаправить посетителя на другой ресурс. Данный фильтр незамедлительно отправляет ресурс в бан.

Links Text – под этот фильтр попадают ресурсы, которые не имеют ключевые поисковые запросы в заголовках и своем контенте. Не самый страшный фильтр, он приводит лишь к тому, что вместо описания ресурса выдается случайный текст, который был найден на страничке. Исправить это легко, всего-навсего нужно использовать мета-теги для описания ресурса.

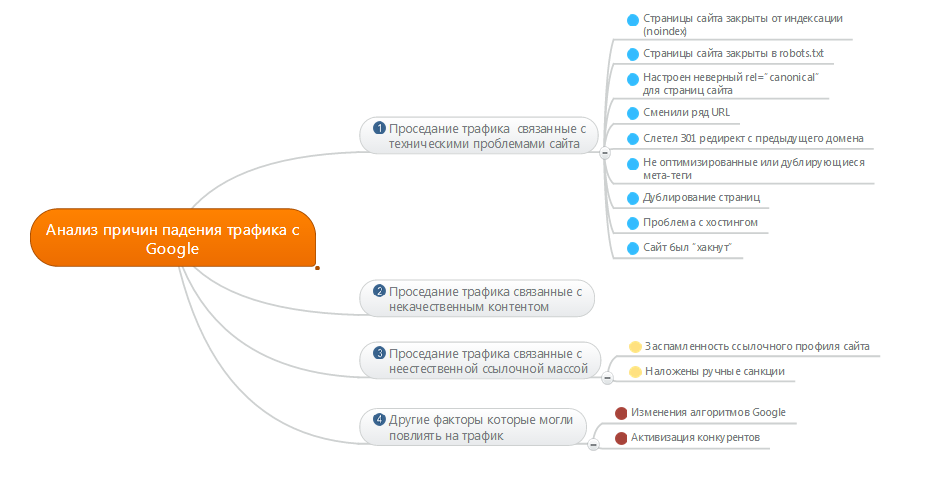

Фильтры Google

Существует мнение, что фильтры Гугл сильнее в своем действии в англоязычной части интернета, нежели русскоязычной. Так что очень может быть, что не все фильтр работают в русскоязычной среде сети.

Sandbox ака песочница – этот фильтр накрывает молодые сайты, которые были созданы не ранее 6 месяцев назад. Из-за этого фильтра поисковая система не выдает страницы этих сайтов в поисковой выдаче по высокочастотникам. Благо, этот фильтр особо не затрагивает низкочастотные запросы, по ним сайт вполне может оказаться в выдаче поисковика. К сожалению, сайт может просидеть в песочнице очень долгое время – от трех месяцев до нескольких лет. Выходом из песочницы может стать хорошая набранная масса естественных ссылок с уважаемых ресурсов.

Bowling – так называют методы черной раскрутки сайтов, которые конкуренты могут использовать, чтобы дискредитировать ваш сайт и занести его в бан. Этот фильтр актуален для новых сайтов с низким уровнем доверия (Trust Rank). Хотя Гугл и утверждает, что конкуренты никоим образом не смогут повлиять на позиции вашего ресурса, есть смысл подать заявку на включение вашего ресурса в индекс, если есть подозрение, что конкурент все-таки отправили вас в бан.

Дополнительные результаты – фильтр Google , который помещает страницы, которые считает недостойными, ниже нормальных, как бы под индекс. При таком раскладе увидеть эти страницы в поисковой выдаче можно будет лишь тогда, когда поисковик сочтет, что нормальных страниц не хватает. Чтобы выйти из-под фильтра понадобится несколько внешних ссылок на ваш сайт.

Bombing – данный фильтр применим к ресурсам, имеющим слишком много ссылок с одинаковым анкором. Избежать попадания под этот фильтр можно используя уникальные анкоры для каждой покупной ссылки.

Возраст домена – фильтр, похожий на песочницу. Есть мнение, что чем старше домен, тем больше у него уровень доверия. К сожалению, молодые ресурсы могут попасть под этот фильтр, проскочив песочницу. Чтобы избежать данного фильтра, опять-таки стоит наращивать ссылочную массу с авторитетных источников.

Дублирующийся контент – фильтры Google , которые понижают сайты с украденным содержанием в выдаче. Так что размещайте только уникальный контент и смотрите, чтобы его никто не украл. Если заметите плагиат с вашего ресурса, может обратиться в Гугл.

Фильтр -30 применяется к ресурсам, которые используют запрещенные методы SEO: дорвеи и редиректы. При обнаружении оных, ресурс понижается по запросам на тридцать пунктов.

Опущенные результаты – данный фильтр влечет за собой выпадение из результатов поисковой выдачи, он распространяется на ресурсы, которые имеют маленькое количество ссылок на себя, заголовки и другие мета-теги, которые повторяются, дублированный контент с других ресурсов или же плохая внутренняя перелинковка страниц.

Социтирование – фильтр, который отслеживает ссылки на ваш сайт и их источники. Если на вас ссылается ресурс инородной тематики, это может повредить тематичности вашего, так как поисковик может приписать вас к той же тематике, что и ссылающийся сайт. Вследствие чего ваш сайт может упасть по тематическим запросам. Дабы этого избежать берите ссылки с ресурсов однородной тематики.

Links – под этот фильтр Гугла попадают страницы, созданные специально для обмена ссылками (линкопомойки). Такой способ уже не эффективен для повышения позиций в выдаче и более того, он не поощряется поисковой системой

Много ссылок сразу – фильтр применяется к сайтам, у которых чересчур быстро увеличивается количество внешних ссылок. Итогом этого может стать бан со стороны поисковой системы. Так что покупать ссылки следует по чуть-чуть.

Чрезмерная оптимизация – фильтр, попасть под который могут сайты с чрезмерным количеством ключевиков и мета-тегов.

Битые ссылки – применяется, когда поисковые роботы находят ссылку, которая ведет на отсутствующую страницу, и они не могут туда добраться, а значит и проиндексировать ее. Это отрицательно влияет на результат поиска и на показателях качества сайта. Поэтому следует избавиться от таких ссылок.

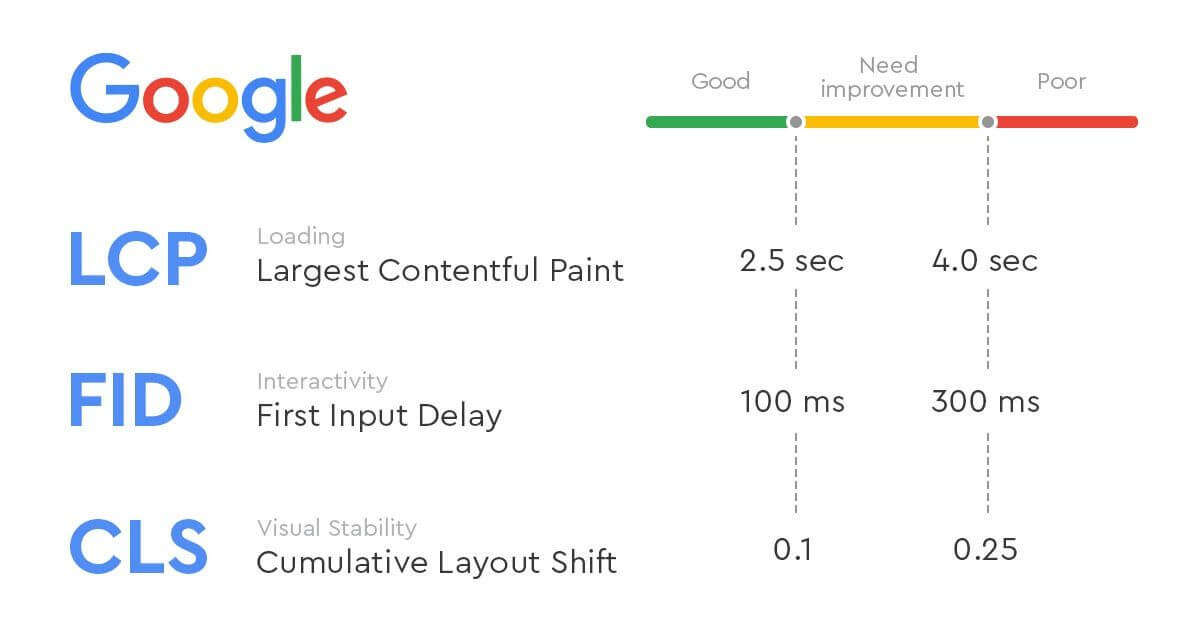

Отфильтровка страниц по времени загрузки. В случае, если страница очень долго загружается от того, что она перегружена эффектами или же имеет проблемы с хостингом, робот может отказаться от ее индексации и она так и не попадет в поисковую выдачу.

Степень доверия ака Google Trust Rank – в данный фильтр включены все показатели перечисленные выше, он учитывает возраст сайта, количество и качество входящих ссылок, количество исходящих ссылок, качество внутренней перелинковки страниц сайта и т.д. И чем выше степень доверия, тем лучше позиции сайта в поисковой выдаче.

|

Поисковые системы, в заботе о пользователях, стараются отсеять сайты, которые на их взгляд кажутся не подобающими и не заслуживающими место в поисковой выдаче. Чтобы осуществить этот самый отсев, |

РэдЛайн, создание сайта, заказать сайт, разработка сайтов, реклама в Интернете, продвижение, маркетинговые исследования, дизайн студия, веб дизайн, раскрутка сайта, создать сайт компании, сделать сайт, создание сайтов, изготовление сайта, обслуживание сайтов, изготовление сайтов, заказать интернет сайт, создать сайт, изготовить сайт, разработка сайта, web студия, создание веб сайта, поддержка сайта, сайт на заказ, сопровождение сайта, дизайн сайта, сайт под ключ, заказ сайта, реклама сайта, хостинг, регистрация доменов, хабаровск, краснодар, москва, комсомольск |

|

Поисковые системы, в заботе о пользователях, стараются отсеять сайты, которые на их взгляд кажутся не подобающими и не заслуживающими место в поисковой выдаче. Чтобы осуществить этот самый отсев, |

РэдЛайн, создание сайта, заказать сайт, разработка сайтов, реклама в Интернете, продвижение, маркетинговые исследования, дизайн студия, веб дизайн, раскрутка сайта, создать сайт компании, сделать сайт, создание сайтов, изготовление сайта, обслуживание сайтов, изготовление сайтов, заказать интернет сайт, создать сайт, изготовить сайт, разработка сайта, web студия, создание веб сайта, поддержка сайта, сайт на заказ, сопровождение сайта, дизайн сайта, сайт под ключ, заказ сайта, реклама сайта, хостинг, регистрация доменов, хабаровск, краснодар, москва, комсомольск |

Дайджест новых статей по интернет-маркетингу на ваш email

Новые статьи и публикации

- 2024-04-22 » Комментирование кода и генерация документации в PHP

- 2024-04-22 » SEO в России и на Западе: в чем основные отличия

- 2024-04-22 » SEO для международного масштабирования

- 2024-04-22 » Как использовать XML-карты для продвижения сайта

- 2024-04-22 » Цифровой маркетинг: инструменты для продвижения и рекламы в 2024 году

- 2024-04-22 » Что такое CSS-модули и зачем они нам?

- 2024-04-17 » 23 сервиса для эффективного экспресс-аудита любого сайта

- 2024-04-08 » Яндекс переходит на новую версию Wordstat

- 2024-04-08 » Яндекс интегрировал в свой облачный сервис эмпатичную нейросеть

- 2024-04-08 » Новая версия нейросети Claude превзошла по мощности аналоги Google и OpenAI

- 2024-04-08 » Как пользоваться GPT 4 и Claude бесплатно и без VPN

- 2024-03-13 » Стратегии SEO на 2024 год

- 2024-03-13 » Как использовать анимацию с помощью JavaScript-библиотеки GSAP

- 2024-03-13 » Использование GSAP 3 для веб-анимации

- 2024-03-13 » Cогласование топографической съёмки с эксплуатирующими организациями

- 2024-02-19 » Теряются лиды? Как настроить сквозную аналитику

- 2024-02-17 » Мерч и IT: на что обратить внимание в 2024 году

- 2024-02-16 » Копируем с RSync: основные примеры синхронизации файлов

- 2024-02-15 » Лучшие noCode AI платформы для создания диалоговых ботов

- 2024-02-14 » Факторы ранжирования Google 2024 — исследование Semrush

- 2024-02-12 » Перенос сайта на другой хостинг

- 2024-02-05 » В России сформирован реестр хостинг-провайдеров

- 2024-02-04 » Использование SSH для подключения к удаленному серверу Ubuntu

- 2024-02-03 » Подключаемся к серверу за NAT при помощи туннеля SSH. Простая и понятная инструкция

- 2024-02-02 » Настройка CI/CD для Gitlab-репозитория: схемы и гайд по шагам

- 2024-02-01 » GitLab CI Pipeline. Запуск сценария через SSH на удаленном сервере

- 2024-01-29 » Introduction to GitLab’s CI/CD for Continuous Deployments

- 2024-01-26 » Настройка GitLab CI/CD

- 2024-01-25 » Установка shell gitlab runner

- 2024-01-25 » Установка и регистрация gitlab-runner в docker контейнере

Тому, кто способен укротить свое сердце, покорится весь мир. (Пауло Коэльо / СИЛА ВОЛИ ) |

Мы создаем сайты, которые работают! Профессионально обслуживаем и продвигаем их !

Как мы работаем

Заявка

Позвоните или оставьте заявку на сайте.

Консультация

Обсуждаем что именно Вам нужно и помогаем определить как это лучше сделать!

Договор

Заключаем договор на оказание услуг, в котором прописаны условия и обязанности обеих сторон.

Выполнение работ

Непосредственно оказание требующихся услуг и работ по вашему заданию.

Поддержка

Сдача выполненых работ, последующие корректировки и поддержка при необходимости.

Мы создаем практически любые сайты от продающих страниц до сложных, высоконагруженных и нестандартных веб приложений! Наши сайты это надежные маркетинговые инструменты для успеха Вашего бизнеса и увеличения вашей прибыли! Мы делаем красивые и максимально эффектные сайты по доступным ценам уже много лет!

Мы создаем практически любые сайты от продающих страниц до сложных, высоконагруженных и нестандартных веб приложений! Наши сайты это надежные маркетинговые инструменты для успеха Вашего бизнеса и увеличения вашей прибыли! Мы делаем красивые и максимально эффектные сайты по доступным ценам уже много лет! Комплексный подход это не просто продвижение сайта, это целый комплекс мероприятий, который определяется целями и задачами поставленными перед сайтом и организацией, которая за этим стоит. Время однобоких методов в продвижении сайтов уже прошло, конкуренция слишком высока, чтобы была возможность расслабиться и получать \ удерживать клиентов из Интернета, просто сделав сайт и не занимаясь им...

Комплексный подход это не просто продвижение сайта, это целый комплекс мероприятий, который определяется целями и задачами поставленными перед сайтом и организацией, которая за этим стоит. Время однобоких методов в продвижении сайтов уже прошло, конкуренция слишком высока, чтобы была возможность расслабиться и получать \ удерживать клиентов из Интернета, просто сделав сайт и не занимаясь им...

Мы оказываем полный комплекс услуг по сопровождению сайта: информационному и техническому обслуживанию и развитию Интернет сайтов.

Мы оказываем полный комплекс услуг по сопровождению сайта: информационному и техническому обслуживанию и развитию Интернет сайтов.

Контекстная реклама - это эффективный инструмент в интернет маркетинге, целью которого является увеличение продаж. Главный плюс контекстной рекламы заключается в том, что она работает избирательно.

Контекстная реклама - это эффективный инструмент в интернет маркетинге, целью которого является увеличение продаж. Главный плюс контекстной рекламы заключается в том, что она работает избирательно.